「生成AIを使いたいけれど、ルールがないから禁止している」

そんな企業は少なくありません。

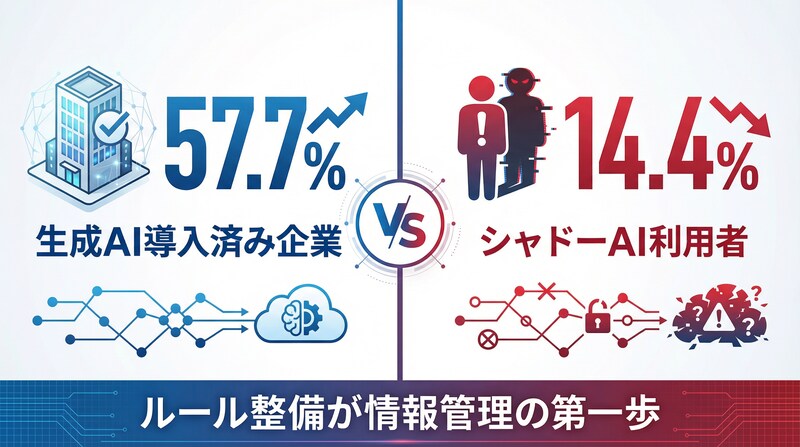

NRI「IT活用実態調査(2025年)」によると、生成AIを導入済みの企業は57.7%です。

一方で、ガイドライン未整備のまま利用を放置すれば、情報漏洩や著作権侵害のリスクが高まります。

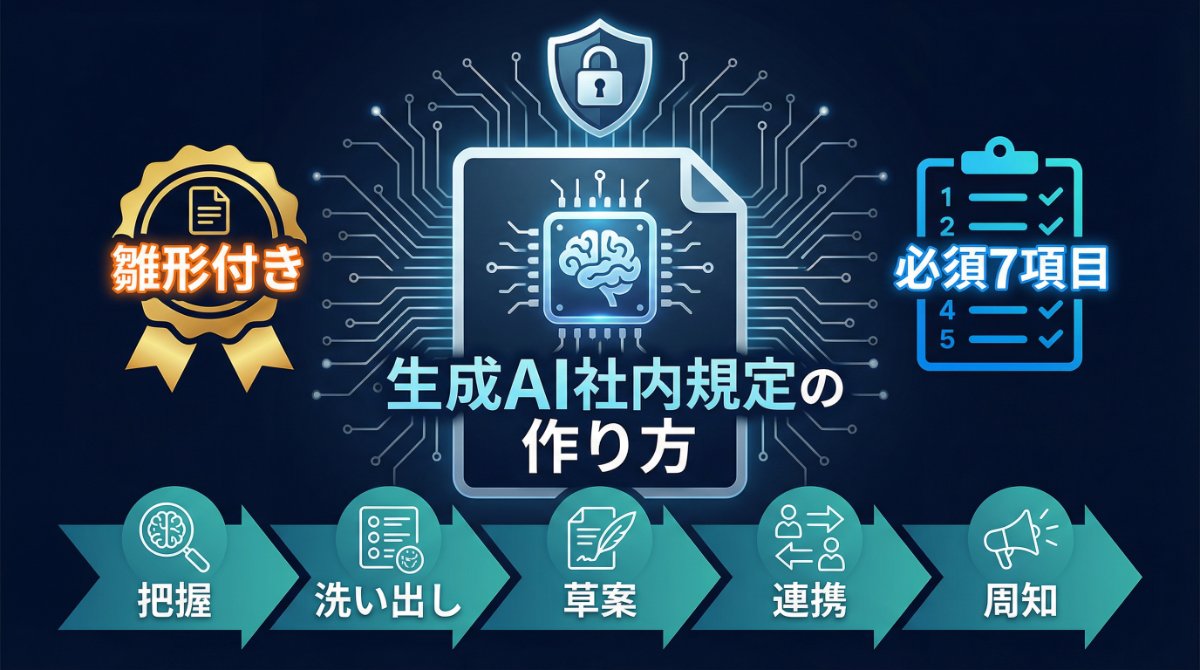

本記事では、社内規定に盛り込むべき7つの必須項目と策定手順を解説します。すぐ使えるテンプレートも紹介しているので、自社に合わせて活用してみてください。

生成AI社内規定が企業に必要な3つの理由

生成AIの業務活用が広がるなか、社内規定の整備は急務です。以下の3つの理由から、ガイドラインの策定が求められています。

- ルール未整備のまま利用が広がるリスクがある

- 情報漏洩や著作権侵害の実害が出ている

- 「全面禁止」では競争力を失う

ルール未整備のまま利用が広がるリスクがある

明確なルールがないまま生成AIの利用が進むと、従業員ごとに使い方がバラバラになります。ある人は顧客データを入力し、別の人は社内文書の要約に使うなど、リスクの大きさが統制できません。

BOXIL調査(2025年12月)では、会社未導入でも個人で無料版を利用している人が14.4%に達しています。こうした「シャドーAI」の放置は、情報管理上の盲点になりやすいです。ルールを先に整備することで、安全な利用の土台を築けます。

情報漏洩や著作権侵害の実害が出ている

生成AIに起因する事故はすでに複数報告されています。2023年には韓国の大手電機メーカーで事故が起きています。従業員が開発中のソースコードをChatGPTに入力し、機密情報が流出しました。

同年3月にはChatGPTのシステム障害も発生しました。有料プランユーザーのチャット履歴やカード情報の一部が、他のユーザーに表示されています。社内規定があれば「何を入力してはいけないか」が明確になり、こうした事故を未然に防げます。

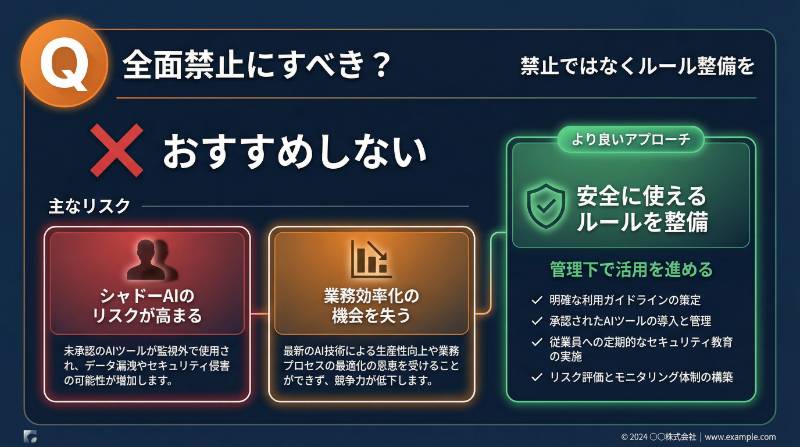

「全面禁止」では競争力を失う

生成AIの利用を全面禁止にする企業もありますが、業務効率化の機会を逃すデメリットは見過ごせません。PwC Japan「生成AIに関する実態調査 2025春」では、日本企業の導入率は56%に達しています。

競合他社がAIで業務を効率化するなか、禁止のままでは生産性の差が広がります。適切なルールを設けて「安全に使える環境」を整えることが、競争力維持の第一歩です。

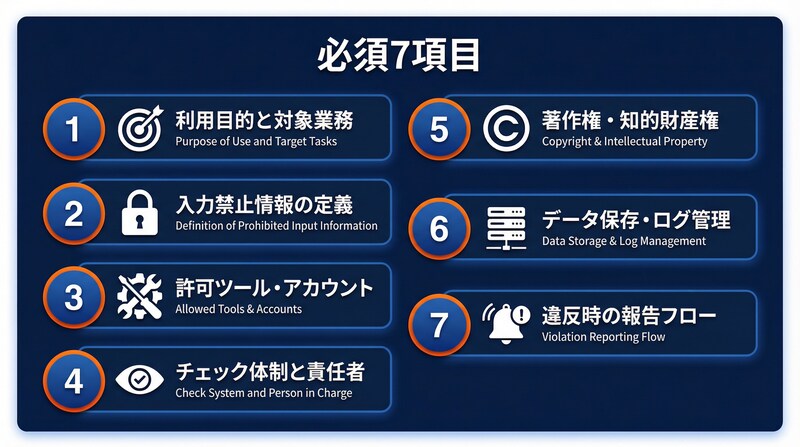

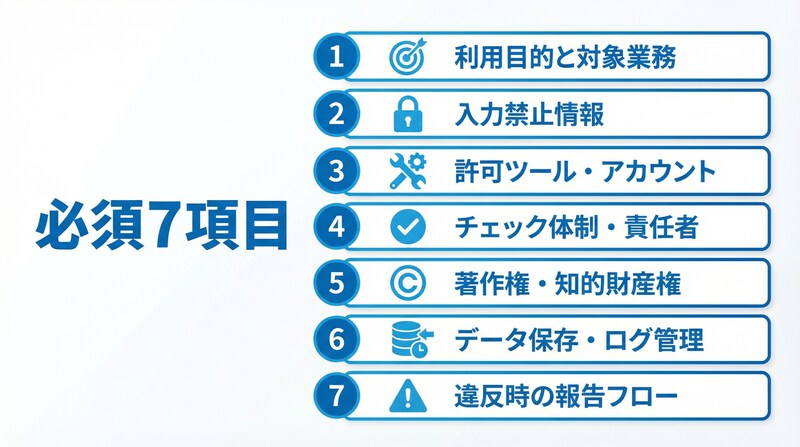

生成AI社内規定に盛り込むべき7つの必須項目

ガイドラインの実効性を高めるには、押さえるべき項目を網羅する必要があります。以下の7つは、どの企業でも盛り込んでおきたい必須項目です。

- 利用目的と対象業務の範囲を定める

- 入力してはいけない情報を明確にする

- 使用を許可するツールとアカウントを指定する

- 出力結果のチェック体制と責任者を決める

- 著作権・知的財産権の取り扱いを規定する

- データ保存とログ管理のルールを設ける

- 違反時の報告フローと対応を整備する

利用目的と対象業務の範囲を定める

まず、生成AIを何の目的で、どの業務に使うのかを明文化します。「業務効率化と品質向上を目的とする」のように、目的を定めておくと判断基準が明確になります。

対象業務の例としては、文書作成の下書き、議事録の要約、リサーチ補助などが挙げられます。一方、最終的な意思決定や顧客対応の自動化は対象外にするなど、線引きを具体的に示しましょう。

入力してはいけない情報を明確にする

生成AI利用で最もリスクが高いのが、機密情報の入力です。入力データがAIの学習に利用される可能性があるため、以下の情報は入力禁止にするのが一般的です。

| 分類 | 具体例 |

|---|---|

| 個人情報 | 氏名、住所、電話番号、マイナンバー |

| 顧客情報 | 取引先データ、契約内容、売上情報 |

| 機密情報 | 未公開の製品情報、ソースコード、経営戦略 |

| 認証情報 | パスワード、APIキー、アクセストークン |

情報を「絶対禁止」「条件付きでOK」「入力可能」の3段階に分類すると、現場で迷いにくくなります。

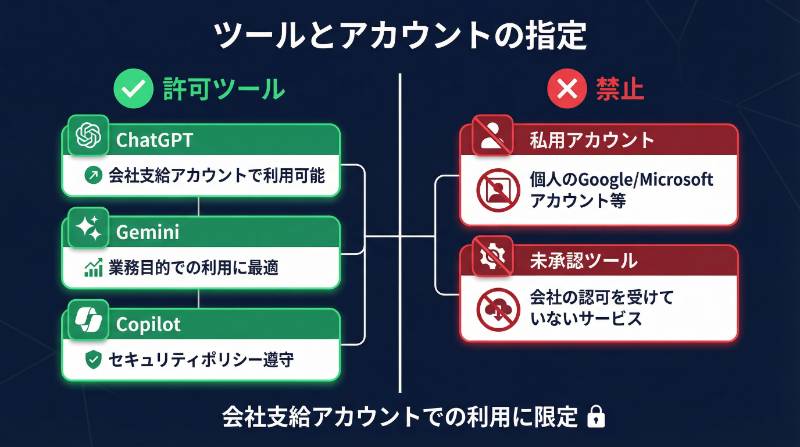

使用を許可するツールとアカウントを指定する

利用を許可する生成AIツールを明示します。ChatGPT、Gemini、Copilotなど、会社が承認したツールのみ使用可とするのが基本です。

私用アカウントの利用は禁止し、会社支給アカウントでの利用に限定しましょう。有料プランには学習データへの利用をオプトアウトできる機能があるものも多く、セキュリティ面でも優位です。

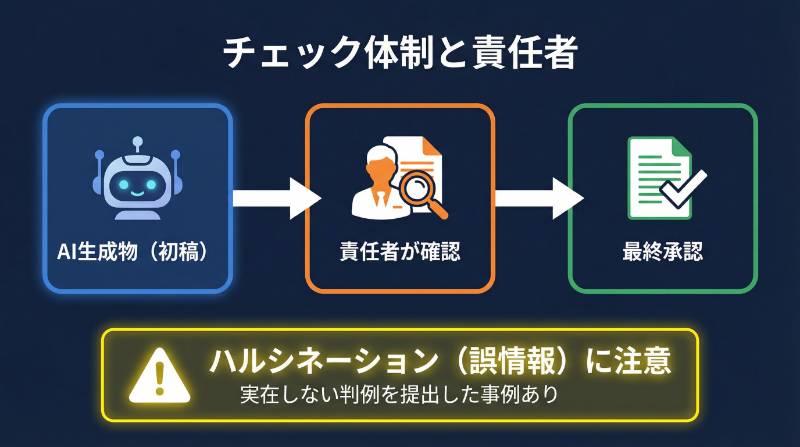

出力結果のチェック体制と責件者を決める

生成AIの出力には「ハルシネーション」と呼ばれる誤情報が含まれる可能性があります。2023年にはアメリカで弁護士がChatGPTの回答を鵜呑みにし、実在しない判例6件を裁判所に提出した事例が報告されています。

AI生成物はあくまで「初稿」として扱い、最終判断は人間が行うルールを徹底しましょう。出力結果の確認責任者を部署ごとに決めておくと、チェック漏れを防げます。

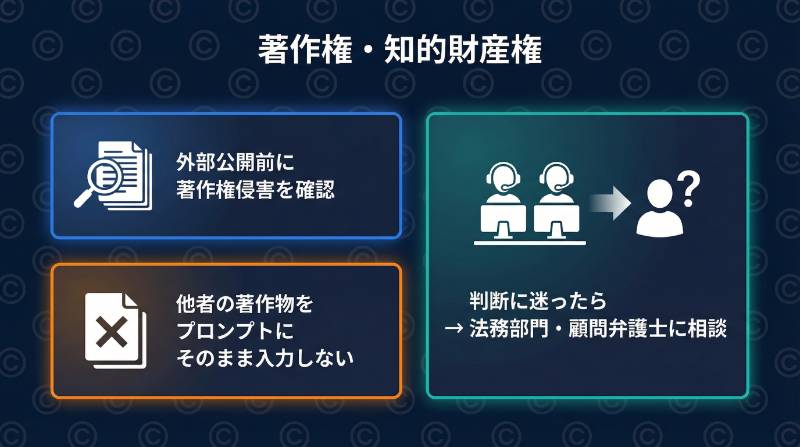

著作権・知的財産権の取り扱いを規定する

生成AIの出力物が、他者の著作物と類似するリスクがあります。著作権侵害が発生した場合の責任の所在を、あらかじめ規定しておくことが必要です。

具体的には、「AI生成物を外部公開する際は著作権侵害がないか確認する」「他者の著作物をプロンプトにそのまま入力しない」などのルールを盛り込みます。判断に迷う場合の相談先として、法務部門や颇問弁護士の連絡先を記載しておくと安心です。

データ保存とログ管理のルールを設ける

生成AIの利用履歴を記録・管理する仕組みも欠かせません。トラブルが発生した際に原因を特定するには、誰がいつどのツールで何を入力したかを追跡できる状態が求められます。

ログの保存期間や管理方法を定め、定期的に利用状況をモニタリングする体制を整えましょう。過度な監視にならないよう、プライバシーへの配慮とのバランスも意識する必要があります。

違反時の報告フローと対応を整備する

ガイドラインに違反した場合や、情報漏洩などのインシデントが発生した場合の対応手順を定めます。報告先、初動対応、エスカレーションの流れを明確にしておくことで、被害の拡大を防げます。

RESUS社会保険労務士事務所の2026年度版ガイドライン例では、就業規則に基づく懲戒規定とあわせて、「指導・注意で十分なケース」との区別も示されています。過度な罰則は萎縮を招くため、段階的な対応を設計しましょう。

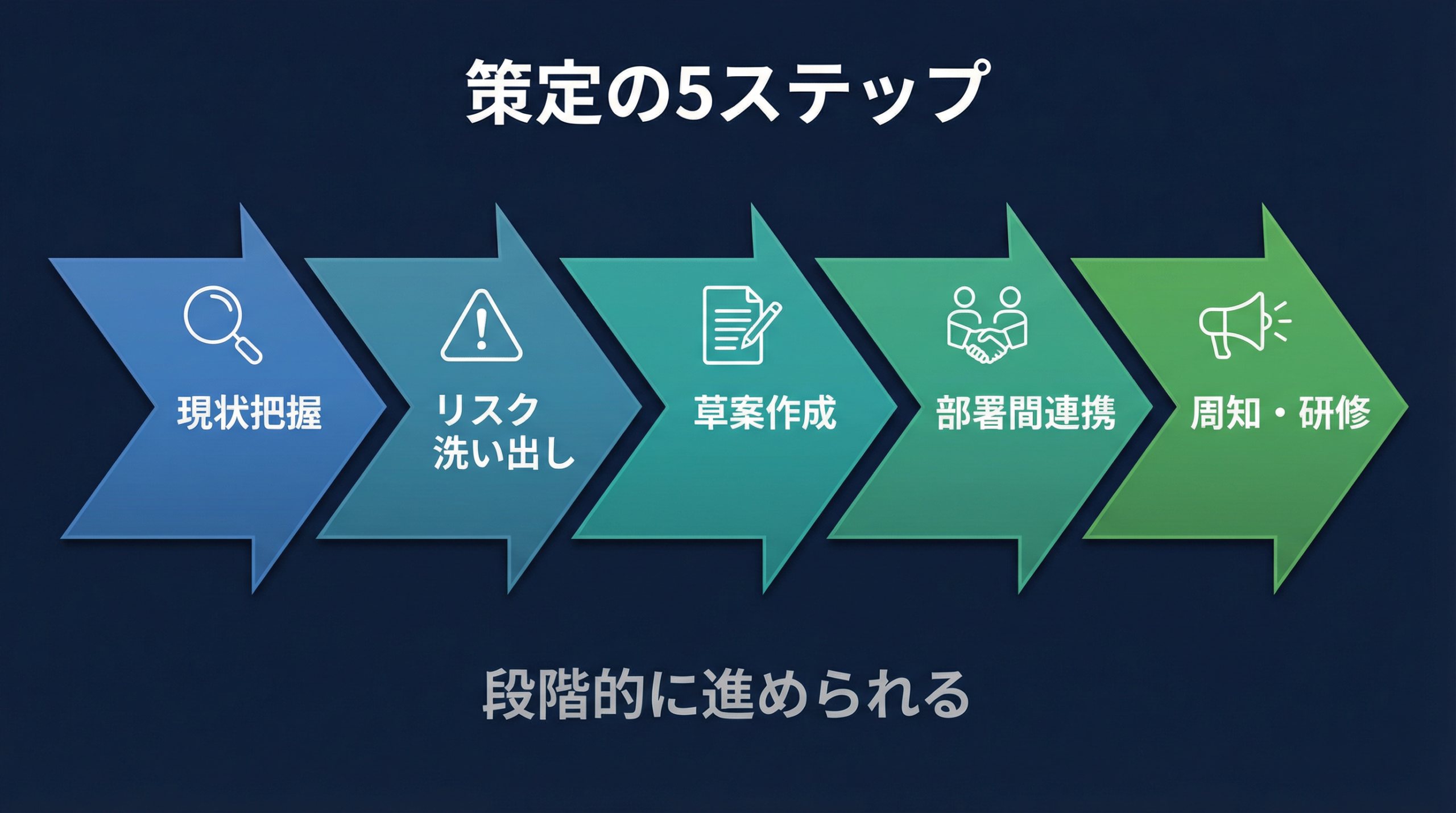

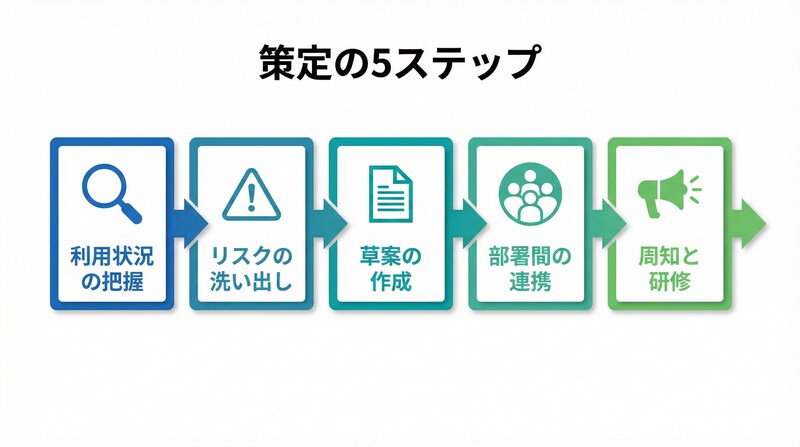

生成AIガイドライン策定の5ステッブ

社内規定は一度に完璧を目指す必要はありません。以下の5ステップで段階的に進められます。

- 社内の利用状況とニーズを把握する

- 想定されるリスクを洗い出す

- ガイドライン草案を作成する

- 関連部署と連携して内容を調整する

- 従業員への周知と研修を実施する

社内の利用状況とニーズを把握する

最初のステップは、現状把握です。社内アンケートやヒアリングを通じて、どの部署がどんな目的で生成AIを使っているかを可視化します。

NRI調査によると、生成AI活用の課題として70.3%の企業が「リテラシーやスキル不足」を挙げています。現場の利用レベルを正確に把握することで、規定の粒度を適切に設定できます。

想定されるリスクを洗い出す

利用状況をもとに、自社にとってのリスクを具体的に列挙します。一般的なリスクと、自社固有のリスクの両面から検討しましょう。

| リスク領域 | 具体的な懵念事項 |

|---|---|

| 情報漏洩 | 機密データのAIへの入力、学習データへの取り込み |

| 著作権侵害 | AI生成物が他者の著作物と類似する |

| 誤情報の拡散 | ハルシネーションによる不正確な情報の社外発信 |

| コンプライアンス | 業界固有の規制への抵触 |

リスクごとに「発生可能性」と「影響度」を評価すると、優先的に対策すべき項目が見えてきます。

ガイドライン草案を作成する

リスク評価の結果を踏まえて、ガイドラインの草案を作成します。ゼロから作る必要はなく、JDLAや各省庁が公開している雛形をベースにカスタマイズするのが効率的です。

草案には前述の7つの必須項目を盛り込みつつ、自社の業務内容やリスク特性に合わせて調整します。最初は簡易版(1〜2ページ)から始めて、運用しながら詳細版へ拡充する方法もあります。

関連部署と連携して内容を調整する

草案ができたら、法務・情報システム・人事・総務など関連部署と内容をすり合わせます。法務部門には著作権や個人情報保護の観点、情シス部門にはセキュリティ面の確認を依頼しましょう。

現場の実務担当者からのフィードバックも欠かせません。机上の空論にならないよう、実際の業務フローに沿ったルールになっているかを検証します。

従業員への周知と研修を実施する

ガイドラインは策定して終わりではなく、全従業員への周知が必要です。説明会やeラーニングを活用し、ルールの内容と背景を理解してもらいましょう。

研修では「なぜこのルールがあるのか」を具体例とともに説明すると効果的です。年1回以上の定期研修を実施し、新入社員向けのオンボーディングにもAIリテラシー教育を組み込むのがおすすめです。

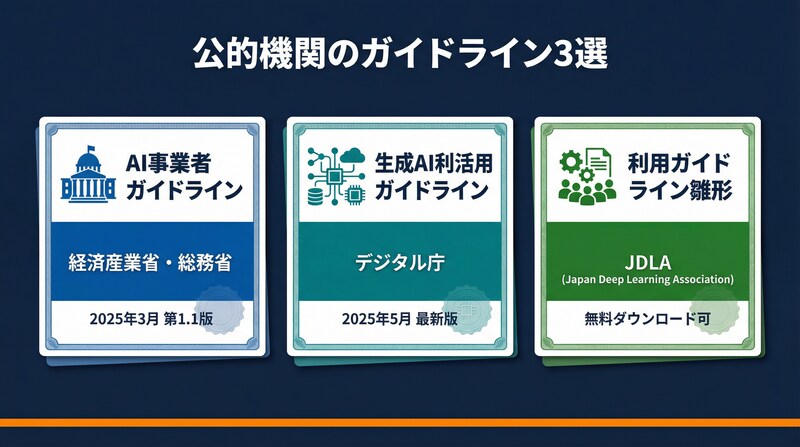

参考にしたい公的機関のガイドライン3選

自社のガイドライン策定にあたっては、公的機関が公開している指針を参照すると、内容の信頼性と網羅性が高まります。以下の3つは特に参考になります。

- 経済産業省・総務省「AI事業者ガイドライン」

- デジタル庁「生成AI利活用ガイドライン」

- JDLA「生成AIの利用ガイドライン」雛形

経済産業省・総務省「AI事業者ガイドライン」

経済産業省と総務省が共同で策定した、AIの安全で信頼性のある活用を促進するための指針です。2024年4月に第1.0版が公開され、2025年3月には第1.1版に改訂されました。

AI開発者・提供者・利用者それぞれの行動指針が示されています。「人間中心」「透明性」「アカウンタビリティ」が柱です。企業の社内規定に「なぜルールが必要か」の根拠として引用する際に役立ちます。

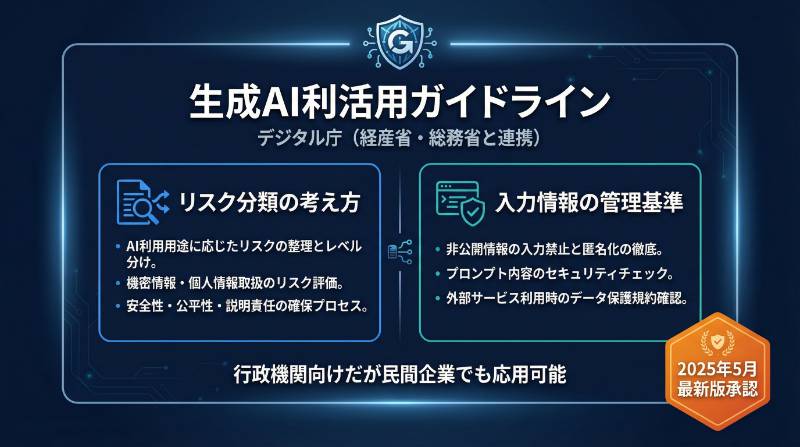

デジタル庁「生成AI利活用ガイドライン」

デジタル庁が経済産業省・総務省と連携して策定した、行政機関向けの生成AI利活用ガイドラインです。2025年5月27日に最新版が承認されました。

行政機関向けの内容ですが、リスク分類の考え方や入力情報の管理基準は民間企業でもそのまま応用できます。「リスクへの対策ガイドブック」もあわせて参照すると、対策の具体像がつかめます。

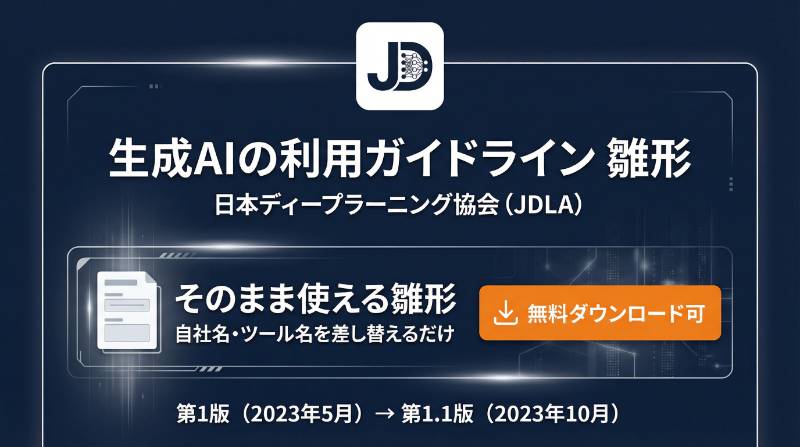

JDLA「生成AIの利用ガイドライン」雛形

日本ディープラーニング協会(JDLA)が公開している、企業向けの利用ガイドライン雛形です。2023年5月に第1版、同年10月に第1.1版が公開されています。

このガイドラインの特徴は、企業がそのまま使える雛形として設計されている点です。自社名や対象ツール名を差し替えるだけで、最低限の規定が完成します。JDLA公式サイトの資料室から無料でダウンロードできます。

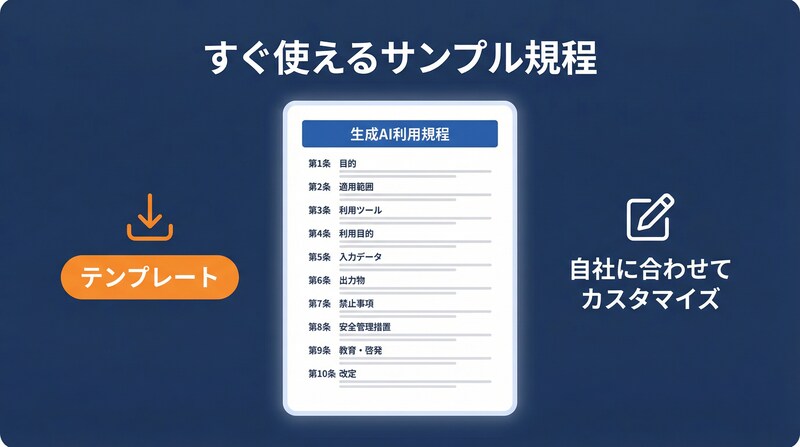

すぐ使える生成AI社内規定のサンプルテンプレート

ここでは、中小企業でもすぐに活用できる生成AI利用ガイドラインのサンプルを紹介します。以下のテンプレートを自社の実情に合わせてカスタマイズしてください。

| 条項 | 内容例 |

|---|---|

| 第1条(目的) | 本規程は、生成AIツールの業務利用に関する基本ルールを定め、情報漏洩等のリスク防止と安全な活用を目的とする |

| 第2条(適用範囲) | 役員、正社員、契約社員、パートタイマー、業務委託先を含む全従業員 |

| 第3条(利用ツール) | 会社が指定する商用AIサービスに限定し、私用アカウントでの利用は禁止する |

| 第4条(入力禁止情報) | 個人情報、顧客情報、機密情報、認証情報の入力を禁止すり |

| 第5条(生成物の扱い) | AI生成物は初稿として扱い、公開・提出前に人間が内容を確認する |

| 第6条(著作権) | 生成物の著作権侵害有無を確認し、問題がある場合は利用を中止する |

| 第7条(ログ管理) | 利用履歴を記録し、管理者が定期的にモニタリングする |

| 第8条(違反時の対応) | 違反を発見した場合は速やかに上長および情報管理責任者に報告する |

| 第9条(教育) | 年1回以上のAIリテラシー研修を全従業員に実施する |

| 第10条(改定) | 技術動向や法規制の変化に応じて、年1回以上の見直しを行う |

このテンプレートはあくまで出発点です。業種や企業規模に応じて、項目の追加や文言の調整を行ってください。テンプレートBANKやJDLAの公式サイトでは、より詳細なWord形式の雛形も無料でダウンロードできます。

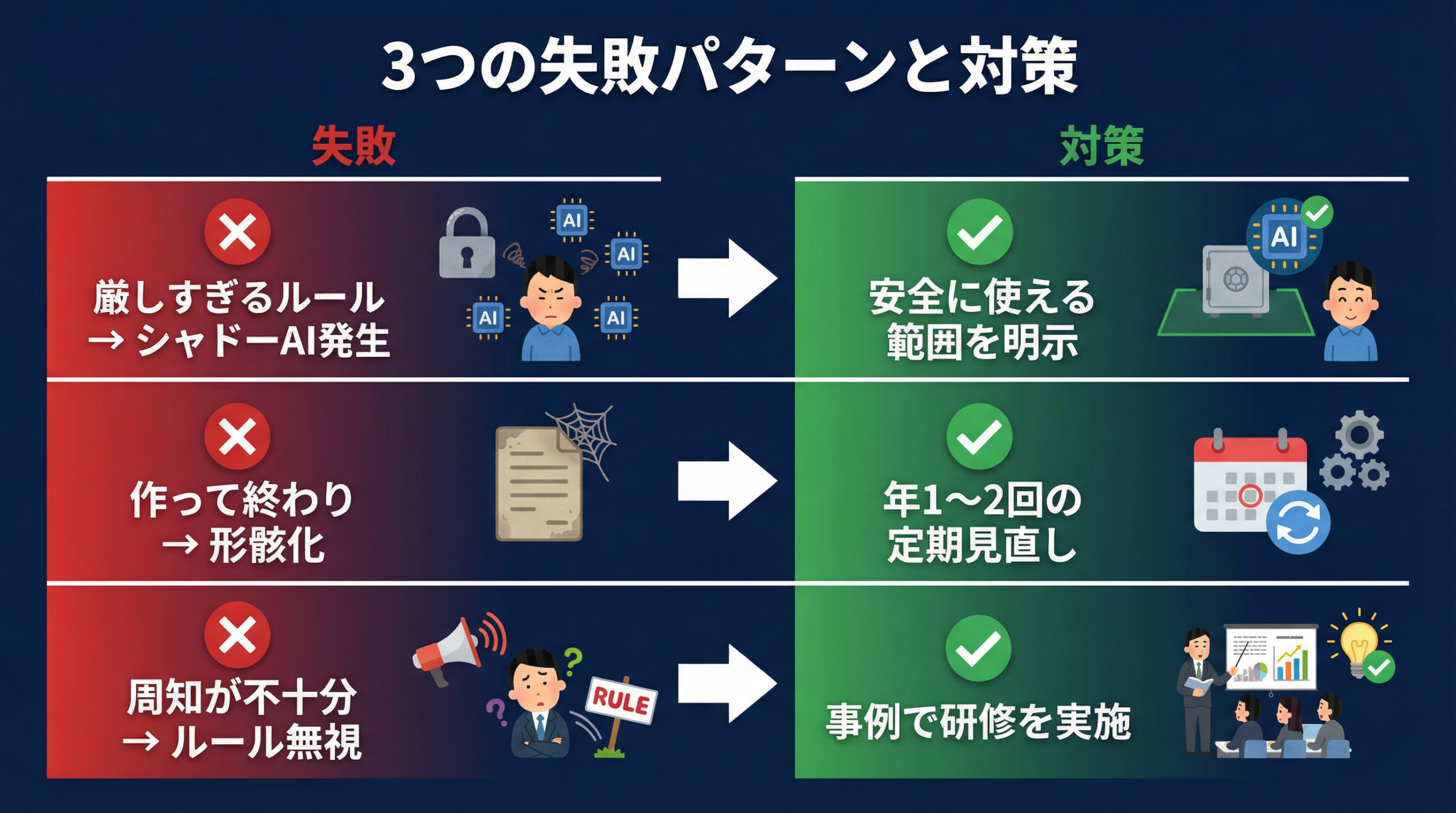

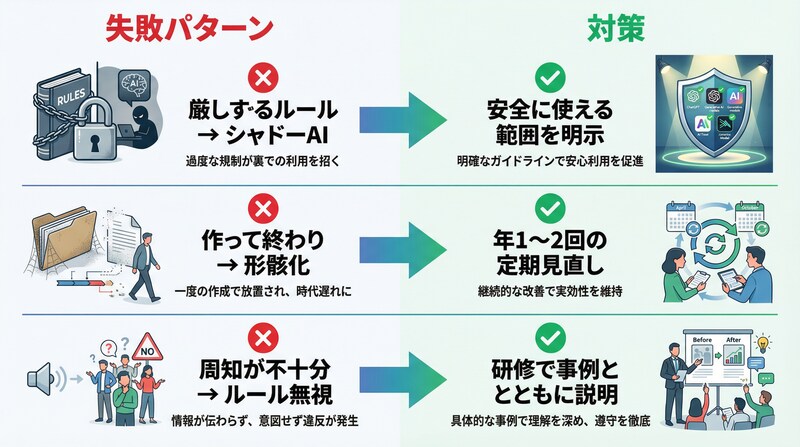

ガイドライン運用でよくある3つの失敗と対策

せっかく作ったガイドラインも、運用を誤ると形骸化してしまいます。以下の3つはよくある失敗パターンです。

- ルールが厳しすぎてシャドーAIが発生する

- 作って終わりで更新されず形骸化する

- 現場への周知が不十分で守られない

ルールが厳しすぎてシャドーAIが発生する

生成AIの利用を過度に制限すると、従業員が個人のスマートフォンや私用アカウントでこっそり使う「シャドーAI」が発生します。会社の管理が及ばない環境での利用は、情報漏洩リスクがかえって高まります。

対策としては、利用を一律禁止にするのではなく、「安全に使える範囲」を明確に示すことが有効です。まずは一部の部署でパイロット運用を行い、成功事例を社内に共有しながら段階的に展開しましょう。

作って終わりで更新されず形骸化する

生成AIの分野は技術の進化が速く、半年前のルールが通用しなくなるケースもあります。作成時点では適切だったガイドラインも、新ツールの登場に対応できなければ形骸化します。

ガイドラインの見直しスケジュールを年1〜2回設定し、担当者を明確にしておくのがポイントです。AI事業者ガイドラインも2025年3月に第1.1版へ改訂されました。公的機関の指針も変化しています。最新動向を定期的にチェックする仕組みを整えましょう。

現場への周知が不十分で守られない

ガイドラインを策定しても、従業員が内容を知らなければ意味がありません。社内ポータルに掲載するだけでは不十分で、能動的な周知活動が欠かせません。

研修で「なぜダメなのか」を事例とともに伝えると、理解度と遵守率が上がります。ルール追加時にはメールやチャットで通知しましょう。FAQを整備しておくと、現場の疑問にも対応できます。

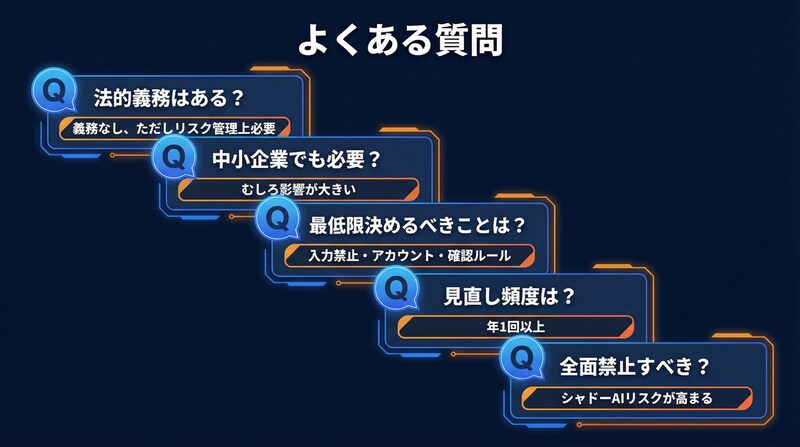

生成AI社内規定についてよくある質問

生成AIの社内規定やガイドラインについて、企業担当者からよく寄せられる疑問をまとめました。策定時の判断材料としてお役立てください。

- 生成AIの社内ガイドラインは法的に義務ですか?

- 中小企業でもガイドラインは必要ですか?

- ChatGPTの社内ルールで最低限決めるべきことは?

- ガイドラインはどのくらいの頻度で見直すべきですか?

- 生成AIの利用を全面禁止にすべきですか?

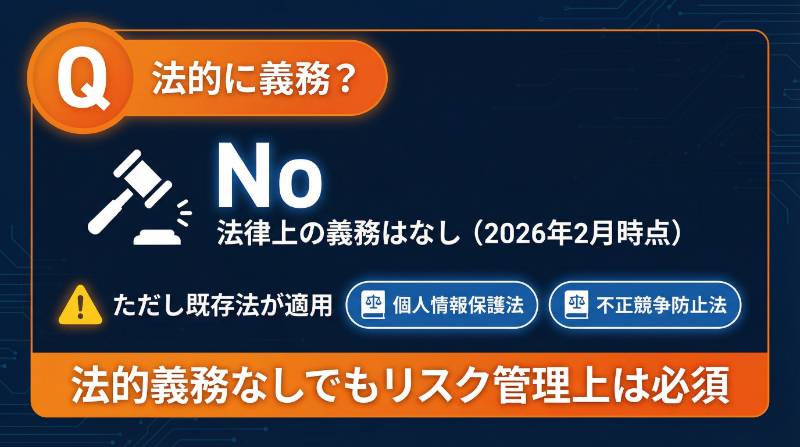

生成AIの社内ガイドラインは法的に義務ですか?

2026年2月時点で、生成AIの社内ガイドライン策定を義務づける法律は日本にはありません。ただし、個人情報保護法や不正競争防止法など、既存の法律に基づく情報管理義務は生成AI利用にも適用されます。法的義務がなくても、リスク管理の観点からガイドライン整備は強く求められています。

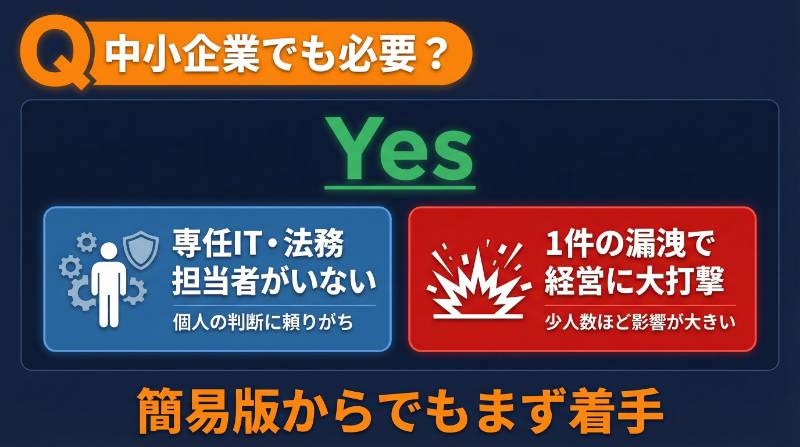

中小企業でもガイドラインは必要ですか?

必要です。中小企業は専任のIT担当者や法務担当者がいないケースも多く、ルールがない状態では個人の判断に頼ることになります。むしろ少人数の組織ほど、1件の情報漏洩が経営に与える影響は大きいです。簡易版のガイドラインからでも、まず着手することが欠かせません。

ChatGPTの社内ルールで最低限決めるべきことは?

最低限決めるべきは次の3点です。「入力禁止情報の宙義」「アカウントの指定」「出力結果の確認ルール」になります。この3つを定めるだけでも、情報漏洩とハルシネーションの2大リスクに対応できます。

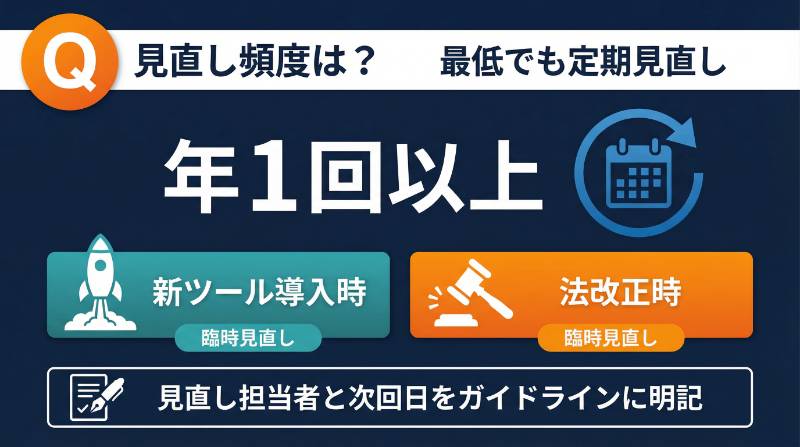

ガイドラインはどのくらいの頻度で見直すべきですか?

最低でも年1回の定期見直しが求められています。生成AI分野は技術や法規制の変化が速いため、新しいツールの導入時や法改正があった際には臨時の見直しも行いましょう。見直し担当者と次回見直し日をガイドラインに明記しておくと、形骸化を防げます。

生成AIの利用を全面禁止にすべきですか?

全面禁止はおすすめしません。従業員が個人端末で使う「シャドーAI」のリスクが高まるうえ、業務効率化の機会も失われます。禁止ではなく「安全に使えるルール」を整備し、管理下で活用を進める方が現実的です。

まとめ

生成AIの業務活用が広がる今、社内規定の整備は先送りにできない課題です。ガイドラインの策定は、企業のリスク管理と競争力維持の両面で欠かせません。

- 社内規定がないとシャドーAIや情報漏洩のリスクが高まる

- 必須項目は入力禁止情報やチェック体制など7つ

- 公的機関の雛形を活用すれば策定の手間を減らせる

- 厳しすぎるルールは逆効果になる

- 年1回以上の見直しで形骸化を防ぐ

まずは簡易版でもよいので、自社に合ったガイドラインを作るところから始めてみてください。本記事で紹介したテンプレートや公的機関の雛形を活用すれば、最短で安全なAI活用環境を整えられます。